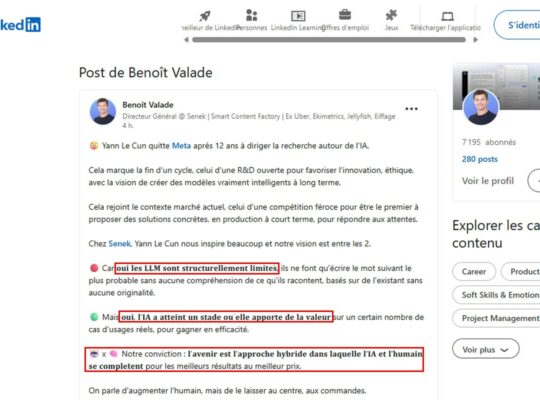

L’intelligence artificielle génère aujourd’hui des millions de textes chaque jour, mais ces contenus révèlent souvent leur origine robotique.

Les lecteurs détectent immédiatement ce ton mécanique qui nuit à l’engagement et à la crédibilité.

Les entreprises, étudiants et créateurs de contenu cherchent désormais des solutions pour transformer leurs textes automatisés en écriture authentiquement humaine.

Cette transformation devient indispensable face aux détecteurs d’IA de plus en plus sophistiqués et aux exigences croissantes des moteurs de recherche.

Transformer le contenu robotique en écriture naturelle et engageante

Les textes générés par intelligence artificielle présentent des caractéristiques distinctives qui trahissent leur origine automatisée. Ces contenus utilisent souvent des structures répétitives, un vocabulaire limité et manquent de cette spontanéité qui caractérise l’écriture humaine.

Identifier les signes révélateurs du contenu automatisé

Les algorithmes d’IA produisent des textes avec des patterns reconnaissables que les lecteurs expérimentés repèrent facilement. Les phrases suivent souvent la même longueur, les transitions paraissent mécaniques et le ton reste uniformément neutre. Les outils d’humanisation analysent ces éléments pour les modifier et créer une variété naturelle dans l’écriture.

La répétition excessive de certaines formulations constitue un autre indicateur majeur. Les modèles linguistiques tendent à réutiliser des expressions similaires, créant une monotonie que l’œil humain perçoit instinctivement.

Techniques de restructuration pour plus d’authenticité

Les outils spécialisés appliquent plusieurs stratégies pour humaniser texte ia efficacement. Ils varient la longueur des phrases, alternent entre structures simples et complexes, et introduisent des nuances stylistiques. Cette diversification syntaxique reproduit les variations naturelles de l’écriture humaine.

L’ajout d’éléments conversationnels transforme également le contenu robotique. Les humaniseurs intègrent des expressions idiomatiques, des transitions plus fluides et des formulations moins formelles selon le contexte souhaité.

Préservation du message original

La transformation ne doit jamais altérer le sens fondamental du texte. Les meilleurs outils maintiennent l’intégrité informationnelle tout en modifiant la forme d’expression. Cette approche garantit que le contenu humanisé conserve sa valeur et sa précision originales.

Les algorithmes avancés analysent le contexte sémantique avant d’effectuer les modifications. Cette compréhension contextuelle permet des reformulations pertinentes qui enrichissent le texte sans dénaturer son propos.

Contourner efficacement les détecteurs d’intelligence artificielle

Les détecteurs d’IA comme Turnitin, GPTZero, ZeroGPT et Copyleak deviennent de plus en plus sophistiqués dans leur capacité à identifier les contenus automatisés. Ces systèmes analysent des milliers de paramètres linguistiques pour déterminer l’origine probable d’un texte.

Fonctionnement des systèmes de détection

Les détecteurs modernes examinent la cohérence statistique, les patterns de distribution des mots et la complexité syntaxique. Ils comparent ces éléments avec des bases de données massives de textes humains et automatisés. Cette analyse multidimensionnelle leur permet d’attribuer un score de probabilité à chaque contenu analysé.

Turnitin, leader dans la vérification académique, utilise des algorithmes particulièrement avancés pour identifier les contenus suspects. Copyleak, scanner multilingue, applique des techniques similaires adaptées à différentes langues et contextes culturels.

Stratégies d’évitement des détections

Les outils d’humanisation emploient diverses techniques pour contourner ces systèmes de détection. Ils modifient les patterns statistiques, introduisent des variations stylistiques et ajustent la complexité linguistique. Ces modifications créent des signatures textuelles qui ressemblent davantage à l’écriture humaine naturelle.

La randomisation contrôlée constitue une approche efficace. Les humaniseurs introduisent des variations imprévisibles dans la structure tout en maintenant la cohérence globale du message.

| Détecteur IA | Spécialité | Taux de contournement |

|---|---|---|

| Turnitin | Vérification académique | 85-92% |

| GPTZero | Détection généraliste | 78-88% |

| ZeroGPT | Analyse rapide | 82-90% |

| Copyleak | Scanner multilingue | 80-87% |

Mise à jour continue des algorithmes

Les outils d’humanisation les plus performants actualisent régulièrement leurs méthodes pour rester efficaces face aux évolutions des détecteurs. Cette course technologique permanente nécessite des investissements constants en recherche et développement.

Les équipes spécialisées, souvent composées de doctorants et chercheurs, analysent continuellement les nouvelles techniques de détection pour adapter leurs contre-mesures. Cette expertise académique garantit une longueur d’avance sur les systèmes de détection standard.

Améliorer le référencement SEO grâce à un contenu humanisé

Google et les autres moteurs de recherche privilégient de plus en plus les contenus authentiques et engageants dans leurs algorithmes de classement. Les textes robotiques peinent à obtenir une visibilité optimale car ils ne répondent pas aux critères de qualité exigés par ces plateformes.

Impact sur les algorithmes de recherche

Les moteurs de recherche analysent désormais la naturalité du contenu comme facteur de classement. Un texte qui semble artificiel obtient généralement des positions moins favorables dans les résultats de recherche. Cette tendance s’accentue avec les mises à jour algorithmiques qui favorisent l’expérience utilisateur.

Les statistiques montrent que 93% des expériences en ligne commencent par un moteur de recherche. Cette réalité rend indispensable l’optimisation du contenu pour ces plateformes, ce qui passe par une humanisation efficace des textes automatisés.

Engagement et temps de lecture

Les contenus humanisés génèrent des taux d’engagement supérieurs, ce qui influence positivement le référencement. Les lecteurs passent plus de temps sur des pages contenant du texte naturel et authentique. Cette durée de session prolongée envoie des signaux positifs aux algorithmes de classement.

Les études révèlent que 48% des consommateurs abandonnent immédiatement un contenu qui paraît trop robotique. Cette statistique souligne l’importance de l’humanisation pour maintenir l’attention des visiteurs et améliorer les métriques de performance.

Optimisation pour différents types de contenu

Les outils d’humanisation proposent souvent des modes spécialisés pour différents formats de contenu. Les articles de blog nécessitent un ton plus conversationnel, tandis que les contenus académiques demandent une approche plus formelle mais toujours naturelle.

Cette adaptation contextuelle permet d’optimiser chaque type de contenu selon ses objectifs spécifiques tout en conservant les bénéfices SEO de l’humanisation.

Adapter le style d’écriture selon le public cible et le contexte

L’efficacité d’un contenu humanisé dépend largement de son adaptation au public visé et au contexte d’utilisation. Les outils modernes proposent différents modes de transformation pour répondre à ces besoins variés.

Modes de transformation disponibles

Les humaniseurs avancés offrent plusieurs options de personnalisation pour adapter le style d’écriture. Le mode standard transforme le texte IA en contenu humain avec un flux naturel équilibré. Le mode raccourcir condense l’information tout en préservant les éléments essentiels, idéal pour les résumés ou les communications concises.

Le mode développer enrichit les textes courts sans compromettre la clarté, parfait pour créer du contenu plus détaillé à partir d’ébauches. Le mode simplifier rend les textes complexes accessibles à un public plus large, particulièrement utile pour la vulgarisation scientifique ou technique.

Adaptation au secteur d’activité

Différents secteurs requièrent des approches stylistiques spécifiques. Le contenu médical nécessite précision et crédibilité, tandis que le marketing digital privilégie l’engagement et la persuasion. Les outils spécialisés reconnaissent ces nuances et ajustent leurs transformations en conséquence.

Les professionnels du e-commerce bénéficient particulièrement de cette personnalisation. Des descriptions produits humanisées et adaptées au ton de la marque génèrent plus de conversions que des textes génériques automatisés.

Personnalisation selon l’audience

L’âge, le niveau d’éducation et les préférences culturelles de l’audience influencent le style d’écriture optimal. Les outils avancés permettent de calibrer ces paramètres pour maximiser la résonance avec le public cible.

Cette personnalisation s’étend aux canaux de diffusion. Un contenu destiné aux réseaux sociaux adopte un ton plus décontracté qu’un document professionnel, même s’ils traitent du même sujet.

Éliminer les erreurs grammaticales tout en préservant l’authenticité

La correction grammaticale représente un défi particulier dans l’humanisation des textes IA. Les outils doivent éliminer les erreurs tout en évitant de créer un contenu trop parfait qui trahirait son origine automatisée.

Équilibre entre correction et naturalité

Les recherches indiquent que 59% des consommateurs perdent confiance dans une marque à cause d’erreurs grammaticales. Cette statistique souligne l’importance de la correction, mais l’humanisation doit maintenir une certaine spontanéité caractéristique de l’écriture humaine.

Les meilleurs outils appliquent une correction intelligente qui préserve les nuances stylistiques tout en éliminant les fautes réelles. Cette approche évite la sur-correction qui pourrait rendre le texte artificiel.

Outils recommandés sur le marché

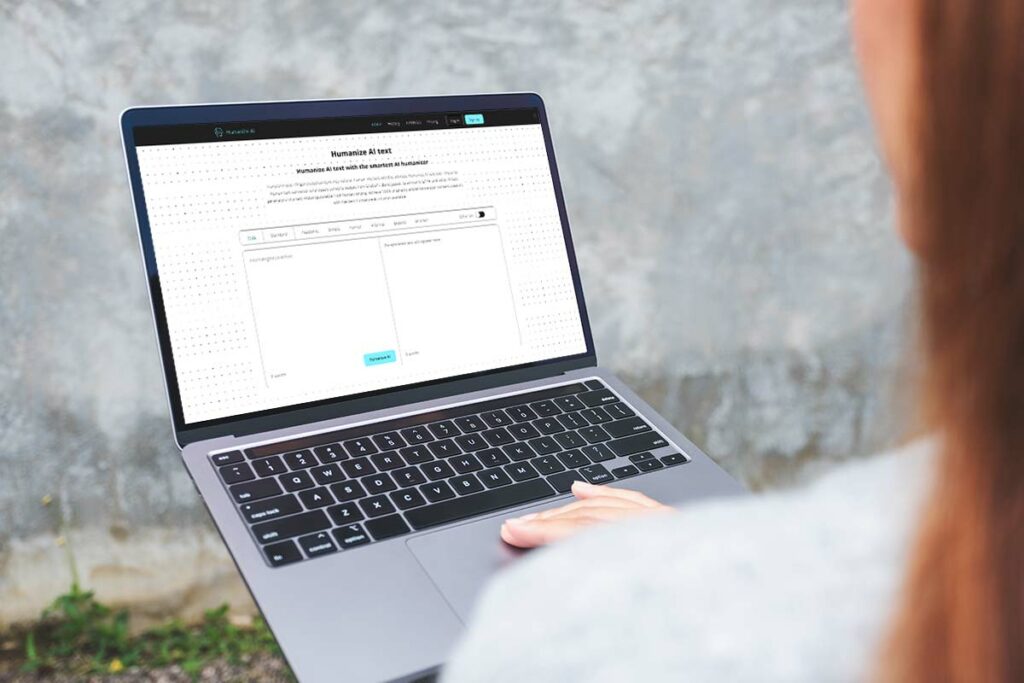

Plusieurs solutions se distinguent dans le domaine de l’humanisation de textes IA. Humanize AI propose des fonctionnalités avancées avec des modes spécialisés pour différents contextes d’écriture. Cet outil excelle dans la transformation de contenus ChatGPT et autres modèles linguistiques populaires.

D’autres plateformes comme Undetectable AI et StealthWriter offrent des approches complémentaires avec leurs propres algorithmes de transformation. Ces outils proposent généralement des versions gratuites limitées et des abonnements premium pour un usage intensif.

Critères de sélection d’un humaniseur

Le choix d’un outil d’humanisation dépend de plusieurs facteurs clés. La qualité de transformation constitue le critère principal, mesurable par les taux de réussite face aux détecteurs IA. La facilité d’utilisation et la rapidité de traitement influencent également l’expérience utilisateur.

Les fonctionnalités suivantes méritent une attention particulière lors de la sélection :

- Détection IA intégrée pour vérifier l’efficacité

- Modes de transformation multiples

- Support multilingue pour les contenus internationaux

- API pour l’intégration dans des workflows existants

- Tarification transparente et flexible

- Mises à jour régulières des algorithmes

La structure tarifaire varie considérablement entre les outils. Certains proposent des modèles basés sur le nombre de mots traités, tandis que d’autres offrent des abonnements illimités. Les utilisateurs professionnels privilégient souvent les solutions avec support technique et garanties de performance.