L’histoire du développement des ordinateurs est un sujet souvent utilisé pour évoquer les différentes générations d’appareils informatiques. Chacune des cinq générations d’ordinateurs se caractérise par une évolution technologique majeure, qui a fondamentalement changé le mode de fonctionnement de ces appareils. La plupart des évolutions majeures survenues entre les années 1940 et aujourd’hui ont abouti à des appareils informatiques toujours plus petits, moins chers, plus puissants et plus efficaces.

Les cinq générations d’ordinateurs, de 1940 à aujourd’hui et au-delà

Notre voyage à travers les cinq générations d’ordinateurs commence en 1940 avec les circuits à tube à vide et se poursuit jusqu’à aujourd’hui et au-delà, avec les systèmes et dispositifs d’intelligence artificielle (IA).

Première génération : les tubes à vide (1940-1956)

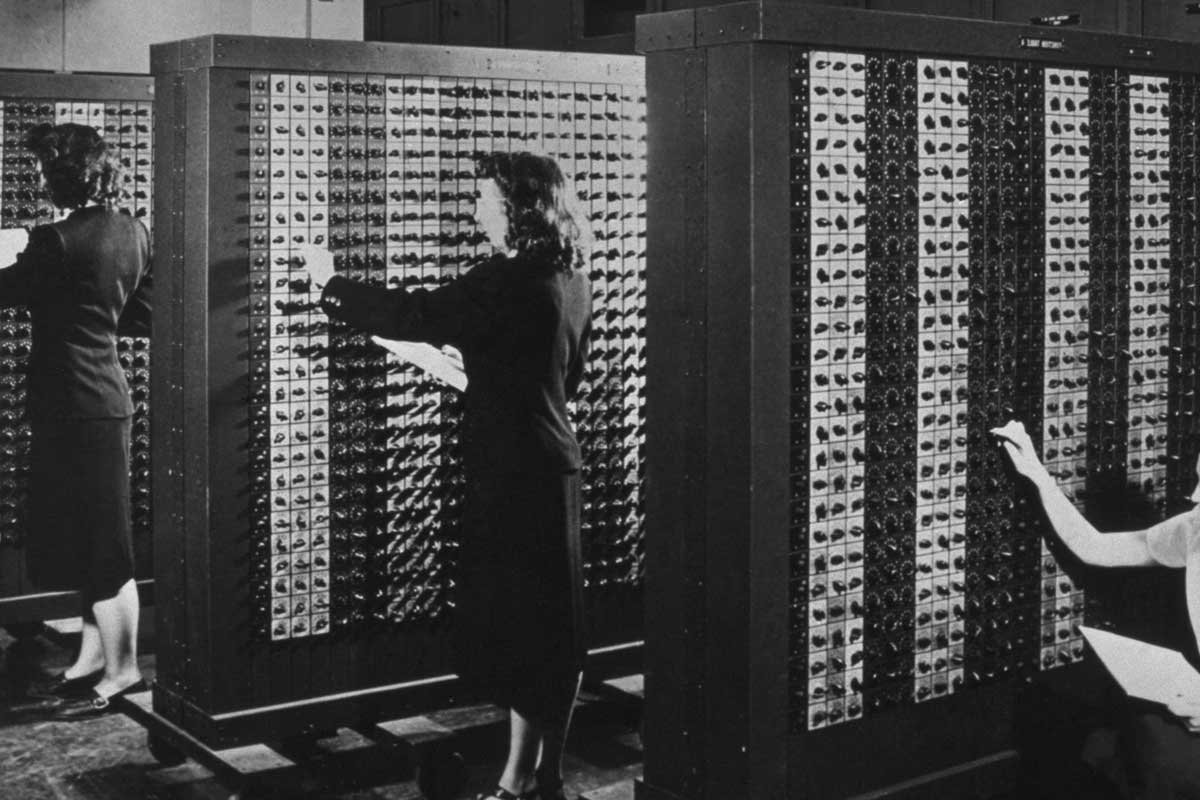

Les premiers systèmes informatiques utilisaient des tubes à vide pour les circuits et des tambours magnétiques pour la mémoire. Leur fonctionnement était également très coûteux et ils consommaient une grande quantité d’électricité. Les premiers ordinateurs produisaient beaucoup de chaleur, ce qui était souvent à l’origine de dysfonctionnements.

Les ordinateurs de la première génération s’appuyaient sur le langage machine, le langage de programmation le plus bas, pour effectuer des opérations, et ne pouvaient résoudre qu’un seul problème à la fois. Il fallait des jours, voire des semaines, aux opérateurs pour résoudre un nouveau problème. L’entrée des données se faisait à l’aide de cartes perforées et de bandes de papier, et les résultats étaient affichés sur des papiers imprimés.

L’UNIVAC et l’ENIAC sont des exemples de dispositifs informatiques de première génération. L’UNIVAC a été le premier ordinateur commercial livré à un client commercial, le Bureau du recensement des États-Unis en 1951.

Deuxième génération : les transistors (1956-1963)

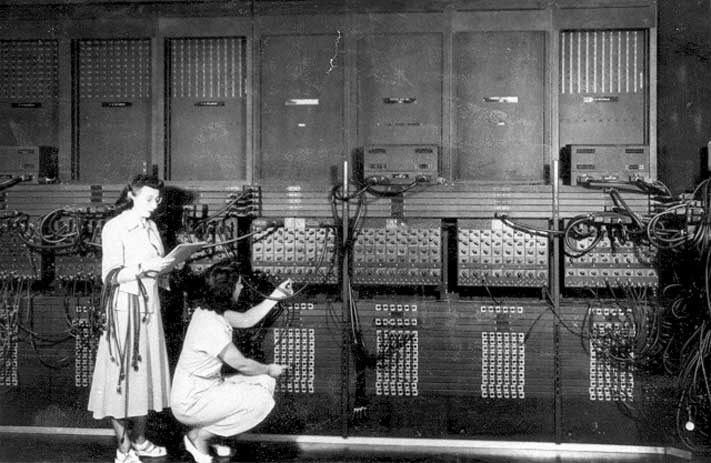

Les transistors allaient remplacer les tubes à vide dans la deuxième génération d’ordinateurs. Le transistor a été inventé aux laboratoires Bell en 1947, mais son utilisation ne s’est généralisée qu’à la fin des années 1950. Le transistor était bien supérieur au tube à vide, permettant aux ordinateurs de devenir plus petits, plus rapides, moins chers, plus économes en énergie et plus fiables que leurs prédécesseurs de la première génération. Bien que le transistor génère encore beaucoup de chaleur, il constitue une amélioration considérable par rapport au tube à vide. Les ordinateurs de la deuxième génération reposaient toujours sur des cartes perforées pour l’entrée et sur des copies papier pour la sortie.

Ces ordinateurs sont passés d’un langage machine binaire cryptique à des langages symboliques ou d’assemblage, qui permettaient aux programmeurs de spécifier des instructions en mots. Des langages de programmation de haut niveau ont également été développés à cette époque, comme les premières versions de COBOL et de FORTRAN. Ces ordinateurs ont également été les premiers à stocker leurs instructions dans leur mémoire, qui est passée de la technologie des tambours magnétiques à celle des noyaux magnétiques. Les premiers ordinateurs de cette génération ont été développés pour l’industrie de l’énergie atomique.

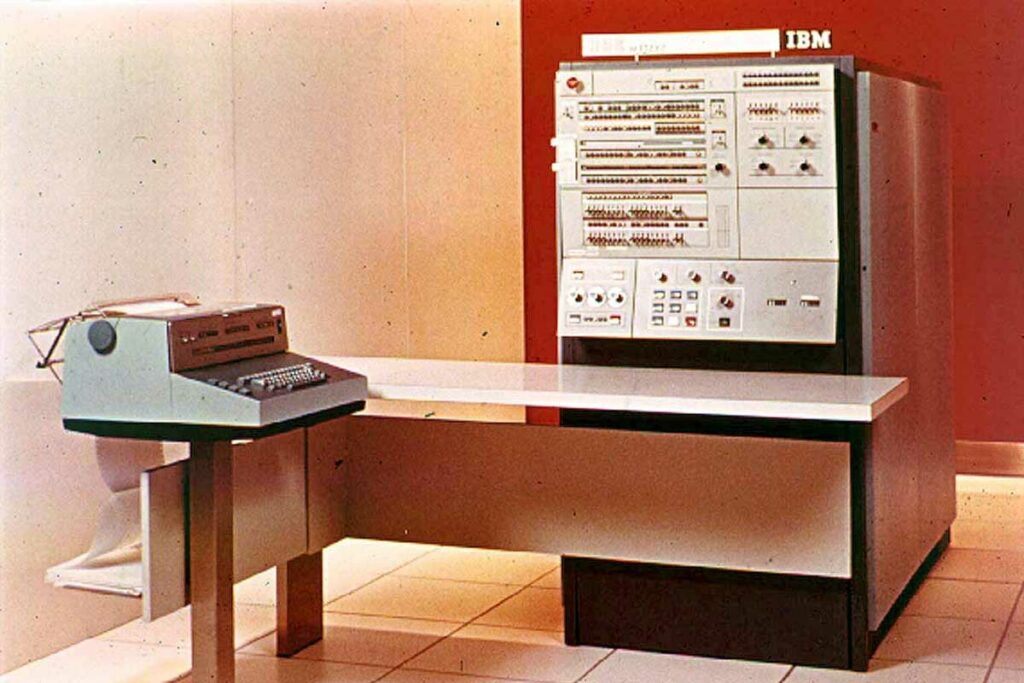

Troisième génération : les circuits intégrés (1964-1971)

Le développement du circuit intégré a marqué la troisième génération d’ordinateurs. Les transistors ont été miniaturisés et placés sur des puces de silicium, appelées semi-conducteurs, ce qui a permis d’augmenter considérablement la vitesse et l’efficacité.

Au lieu de cartes perforées et d’imprimés, les utilisateurs interagissaient par le biais de claviers et d’écrans, ainsi qu’avec un système d’exploitation, qui permettait à l’appareil d’exécuter de nombreuses applications différentes en même temps, avec un programme central contrôlant la mémoire. Pour la première fois, ils sont devenus accessibles à un public de masse, car ils étaient plus petits et moins chers que leurs prédécesseurs.

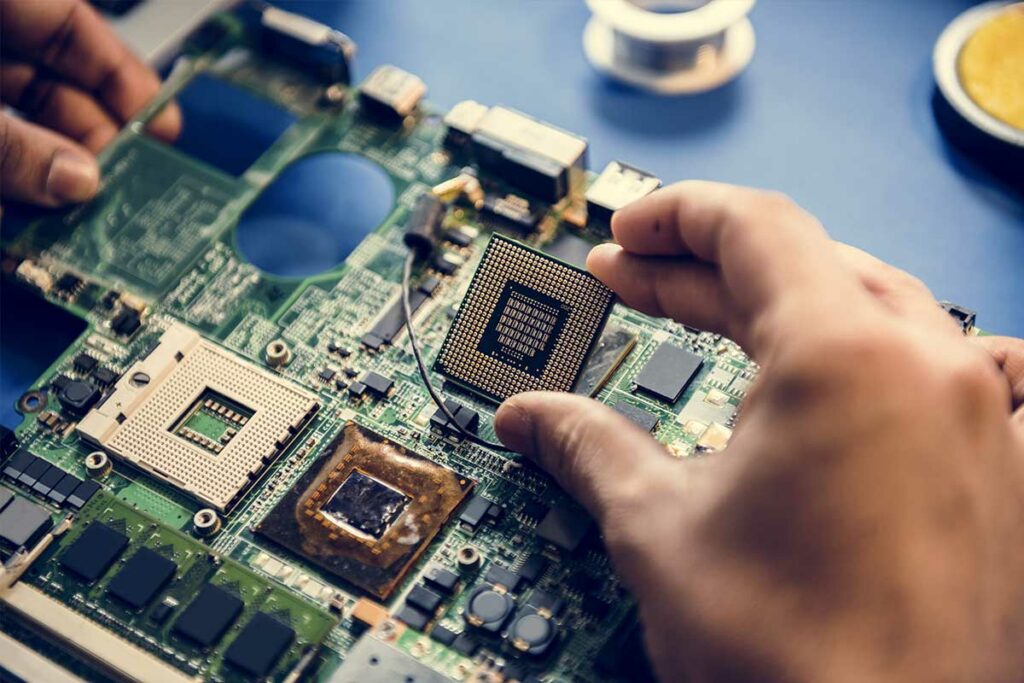

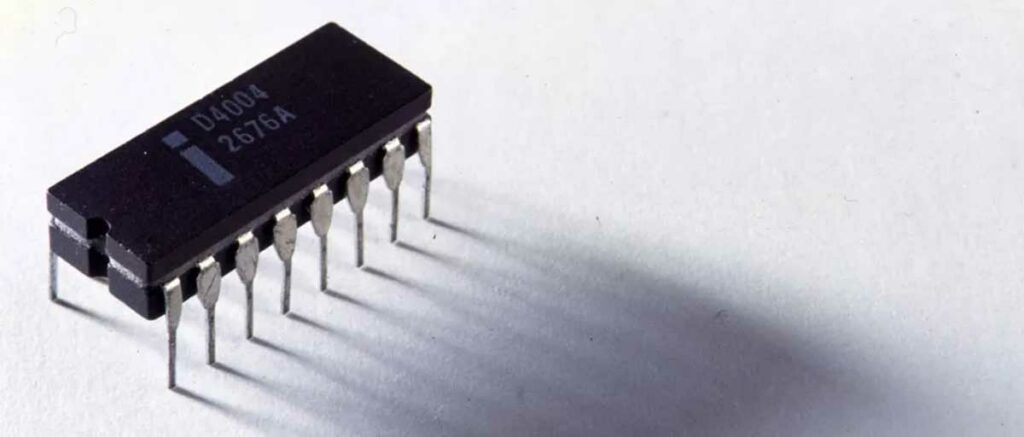

Quatrième génération : les microprocesseurs (1971-aujourd’hui)

Le microprocesseur a donné naissance à la quatrième génération d’ordinateurs, des milliers de circuits intégrés ayant été construits sur une seule puce de silicium. Ce qui remplissait une pièce entière lors de la première génération tient désormais dans la paume de la main. La puce Intel 4004, développée en 1971, a placé tous les composants, de l’unité centrale de traitement et de la mémoire aux commandes d’entrée/sortie, sur une seule puce.

En 1981, IBM a présenté son premier ordinateur destiné aux particuliers et, en 1984, Apple a lancé le Macintosh. Au fur et à mesure qu’ils devenaient plus puissants, ils ont pu être reliés entre eux pour former des réseaux, ce qui a finalement conduit au développement de l’internet. La quatrième génération d’ordinateurs a également vu le développement des interfaces graphiques, de la souris et des appareils portables.

Cinquième génération : intelligence artificielle (aujourd’hui et après)

Les dispositifs informatiques de cinquième génération, basés sur l’intelligence artificielle, sont encore en cours de développement, bien que certaines applications, telles que la reconnaissance vocale, soient actuellement utilisées. L’utilisation du traitement parallèle et des supraconducteurs contribue à faire de l’intelligence artificielle une réalité. L’informatique quantique et la nanotechnologie moléculaire changeront radicalement le visage des ordinateurs dans les années à venir. L’objectif de l’informatique de cinquième génération est de mettre au point des appareils qui réagissent à des entrées en langage naturel et qui sont capables d’apprendre et de s’auto-organiser.